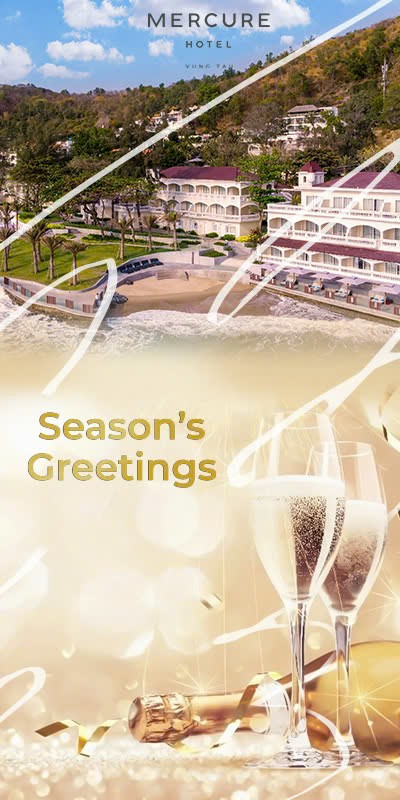

Bức ảnh Tom Hanks thu hút chú ý tại Hội nghị Black Hat ở Mỹ đầu tháng 8 không phải là ảnh thật mà được tạo ra từ AI.

Philip Tully, nhà khoa học dữ liệu tại công ty bảo mật FireEye, là tác giả của tấm hình Hanks giả. Mục đích của ông khi tạo ra trò lừa bịp này là để kiểm tra liệu phần mềm mã nguồn mở có thể tạo ra thông tin sai lệch hay không. Tully kết luận: “Những người không có nhiều kinh nghiệm cũng có thể sử dụng các mô hình học máy và tạo ra nhiều thứ với chúng”.

Hình ảnh Deepfake của diễn viên Tom Hanks. Ảnh: FireEye.

Khi phóng to bức ảnh, các chuyên gia phát hiện ra nhiều điểm chưa thật, như nếp gấp cổ và kết cấu da chưa tự nhiên trên khuôn mặt của Hanks. AI đã tái tạo chính xác các chi tiết quen thuộc trên khuôn mặt của nam diễn viên, như lông mày nhíu lại và đôi mắt xám xanh. Ở kích thước nhỏ như một hình đại diện trên mạng xã hội, hình ảnh do AI tạo ra dễ đánh lừa người dùng là hình thật.

Để tạo ra những hình ảnh này, Tully thu thập vài trăm hình ảnh của Hanks trên mạng và chi chưa đến 100 USD để điều chỉnh phần mềm mã nguồn mở cho gương mặt đã chọn. Tully cũng sử dụng phần mềm AI mã nguồn mở khác để bắt chước giọng nói của diễn viên từ ba clip trên YouTube nhưng kết quả không ấn tượng.

Bằng cách chứng minh một người có thể tạo ra các bức ảnh giả như thật với giá rẻ và cách làm dễ dàng, dự án của FireEye làm nhiều người lo ngại về nguy cơ lan truyền tin giả trên mạng nhờ AI. Kết hợp giữa deep learning (học sâu) và fake (giả mạo), deepfake cho phép người dùng tạo ra ảnh, giọng nói và video sinh động như thật nhờ vào dữ liệu có sẵn.

Hầu hết video deepfake tràn lan trên mạng đều có chất lượng thấp và được tạo ra chỉ nhằm mục đích giải chí hoặc khiêu dâm. Cho đến nay, hành vi sử dụng deepfake độc hại được ghi nhận phần lớn là để quấy rối phụ nữ. Tuy nhiên, các thành viên của Quốc hội Mỹ lo ngại rằng deepfake có thể bị sử dụng vào mục đích can thiệp chính trị.

Hiện nay rất nhiều nhóm nghiên cứu AI học thuật hay thương mại đều công khai những tiến bộ mới nhất của họ và biến nó thành mã nguồn mở. Thí nghiệm làm giả Tom Hanks của Tully đã tận dụng những phần mềm mở này và một kỹ thuật tên là fine-tuning để tinh chỉnh mô hình huấn luyện.

Một vài gương mặt được tạo ra từ trí tuệ nhân tạo của Nvidia.

Nhờ vào công cụ mở StyleGAN của Nvidia, Tully còn tạo ra một mô hình khuôn mặt trong vòng chưa đầy một ngày trên một bộ xử lý đồ họa đám mây. Đặc biệt, ông có thể sao chép giọng nói của Hanks trong vài phút chỉ bằng máy tính xách tay. Ba đoạn âm thanh 30 giây được tái tạo dựa vào dự án tổng hợp giọng nói của Google.

Theo Tully, khi cuộc cạnh tranh giữa các viện nghiên cứu AI ngày càng khốc liệt, những kết quả được họ công bố sẽ đem lại nhiều tác động tiêu cực hơn là tích cực cho xã hội.

Tim Hwang, thành viên tại Trung tâm An ninh và Công nghệ mới tại Georgetown, cho biết các thử nghiệm như của FireEye sẽ lại làm nóng lên cuộc tranh luận về nguy cơ gây ra bởi deepfake. Trong một báo cáo công bố tháng trước, Hwang đã nhận định hiện tại deepfake không đặt ra mối đe dọa nào, tuy nhiên, việc đầu tư nguồn vốn vào các biện pháp phòng ngừa nên được tính càng sớm càng tốt. Hwang đề xuất các viện nghiên cứu tạo ra một trung tâm phát hiện deepfake, trong đó chứa các sản phẩm được tạo ra nhờ nguồn mở. Một số công ty như Nvidia đã công bố công cụ giúp phát hiện deepfake được tổng hợp từ phần mềm của hãng.

Facebook gần đây cũng tạo ra một loạt video deepfake và treo giải 500.000 USD cho công cụ phát hiện deepfake nào hoạt động tốt nhất. Công cụ chiến thắng cũng chỉ phát hiện thành công 65% các video deepfake trong bộ sưu tập của Facebook.

Theo Lee Foster, quản lý nhóm phân tích hoạt động thông tin của FireEye cho biết, năm ngoái, công ty này đã vạch trần một chiến dịch lan truyền thông tin sai lệch nhằm mục đích ủng hộ Iran. Các chiến dịch này sử dụng các nhân vật giả mạo trên Twitter và Facebook, thậm chí còn lừa các chuyên gia về chính trị Trung Đông đưa ra các cuộc phỏng vấn tuyên truyền thông điệp của hoạt động.

Theo Foster, dựa vào thí nghiệm của Tully và kinh nghiệm của chính anh với nạn tin giả, anh nghĩ rằng những kẻ muốn lan truyền tin giả sẽ sớm chuyển sang dùng deepfake. Ảnh đại diện được lấy từ Internet là manh mối thường được các nhà điều tra dựa vào để phát hiện các nhân vật giả mạo. Foster nói: “Ngày nay tốc độ chúng ta tiếp nhận thông tin giống tốc độ chúng ta sống. Nếu bạn lướt Twitter quá nhanh, bạn sẽ không thể nào nhìn đủ kỹ các tấm hình đại diện”.

Đăng Thiên (theo Wired)